Limones

Un limón es atractivo a la vista y amargo al probarlo. En argot americano, un "lemon" es un producto que parece bueno por fuera pero está averiado por dentro — un cacharro. En 1970, Akerlof usó la metáfora para explicar cómo los mercados se destruyen cuando el comprador no puede distinguir la calidad. Hoy, casi todos los productos digitales se presentan como "AI-powered". La señal brilla. Lo que hay dentro es más difícil de saber.

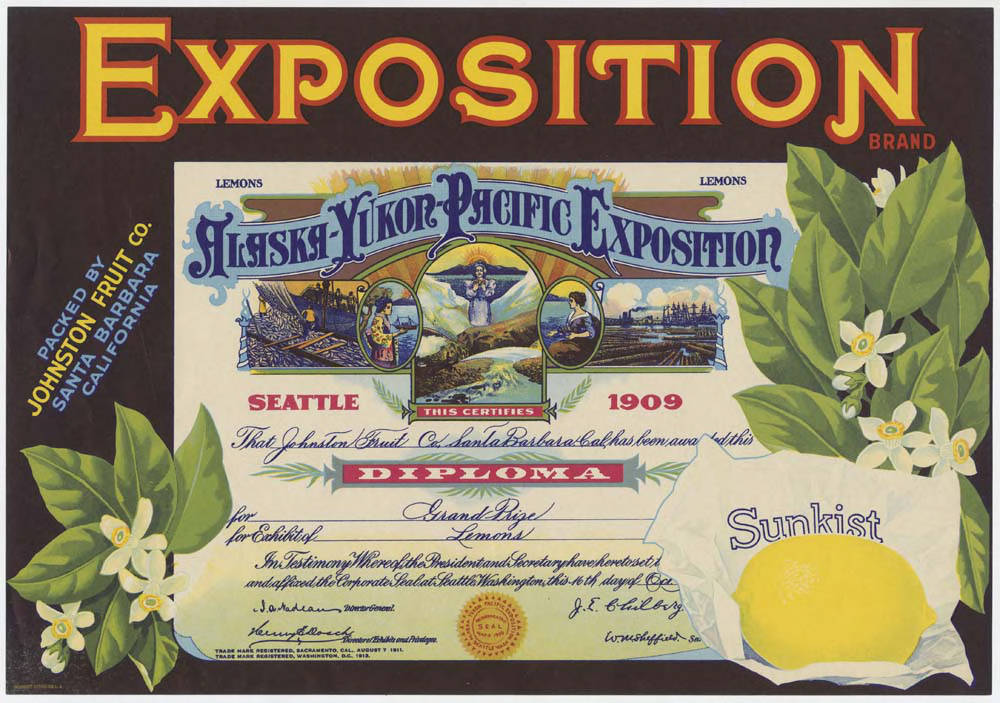

Etiqueta Exposition Brand Sunkist lemons, c. 1912. Los productores de cítricos de California competían a través del diseño de las etiquetas porque la fruta dentro de cada caja era indistinguible. Museum of History and Industry, Seattle.

Un limón es atractivo a la vista. Amarillo intenso, piel tersa, forma que cabe en la mano. Nada en su exterior advierte de lo que ocurre al morderlo. La amargura es invisible desde fuera.

En el argot americano, lemon es la palabra para un producto que parece bueno pero está averiado por dentro. Un cacharro. Un coche de segunda mano con la pintura reluciente y el motor a punto de romperse. La metáfora es precisa: lo que define al lemon no es que sea malo, sino que no puedes saberlo antes de probarlo. El exterior no revela el interior.

En 1970, George Akerlof convirtió esa intuición cotidiana en un artículo que le valdría el Nobel. En The Market for "Lemons", publicado en el Quarterly Journal of Economics, partió de una observación sobre el mercado de coches de segunda mano. Un vendedor que ha cuidado meticulosamente su coche sabe que es bueno. Pero el comprador no puede saberlo. Desde fuera, un coche bien mantenido y un desastre mecánico parecen iguales. Ante esa incertidumbre, el comprador ofrece un precio que refleja la calidad media del mercado. El vendedor del buen coche, que sabe que su vehículo vale más, se retira. Quedan los malos. La calidad media baja. El comprador ajusta su oferta a la baja. Y así, en una espiral descendente, el mercado se llena de lemons y los buenos productos desaparecen.

El mecanismo es la asimetría de información: una de las partes sabe algo que la otra no puede verificar. Akerlof demostró que esa asimetría, por sí sola, puede destruir mercados enteros. No hace falta fraude. No hace falta mala fe. Basta con que el comprador no pueda distinguir.

Ahora mira a tu alrededor. En algún momento de los últimos dos años, casi todos los productos digitales que conoces añadieron la palabra "AI" a su descripción. Un CRM que llevaba ocho años funcionando con reglas de negocio convencionales pasó a ser "AI-powered". Una herramienta de gestión de proyectos que siempre había ordenado tareas por prioridad manual ahora lo hacía "con inteligencia artificial". Algunos se declaran "AI native" a pesar de llevar años en el mercado — native implica que nacieron así, pero si tu producto existía en 2019 y no mencionaba la inteligencia artificial, no eres nativo de nada. Eres un converso.

La pregunta interesante no es si mienten — muchos no mienten, han integrado capacidades reales —, sino por qué necesitan decirlo con tanta urgencia. ¿Qué están señalizando exactamente, y a quién?

El mercado que se enturbia

Erlei y sus colegas han aplicado este marco al mercado de sistemas de IA, y lo que encuentran es exactamente lo que predice la teoría. En When Life Gives You AI, Will You Turn It Into A Market for Lemons? (2026), muestran que la asimetría entre quienes desarrollan sistemas de IA y quienes los compran es estructural. El comprador no puede evaluar la calidad real de un sistema de IA antes de comprarlo e integrarlo en su contexto. Las demos son controladas. Los benchmarks miden rendimiento en condiciones de laboratorio. Los casos de éxito son seleccionados. El vendedor conoce las limitaciones — las alucinaciones, los sesgos, los casos límite donde el sistema falla — y el comprador no.

Stigler formalizó en 1961 que buscar información tiene un coste: comparar, evaluar, probar. En The Economics of Information, mostró que los compradores racionales dejan de buscar cuando el coste de una consulta más supera el beneficio esperado. En el mercado de IA, ese coste de búsqueda es enorme. Evaluar si un modelo funciona bien para tu caso de uso específico requiere expertise técnico, pilotos prolongados, integración con tus datos. La mayoría de las organizaciones no pueden permitírselo. Así que hacen lo que cualquier agente racional haría bajo esas condiciones: eligen al que mejor se presenta.

La señal

En 1973, Michael Spence propuso una solución elegante al problema de Akerlof. En Job Market Signaling, observó que en los mercados laborales, donde el empleador no puede saber de antemano si un candidato es bueno, los candidatos usan señales para distinguirse. La señal clásica es la educación. Un título universitario no funciona necesariamente porque enseñe habilidades relevantes. Funciona porque obtenerlo es costoso — en tiempo, esfuerzo, dinero — y es más costoso para quienes carecen de la capacidad que señaliza. Es una señal separadora: permite distinguir tipos precisamente porque no todos pueden emitirla.

La clave del modelo de Spence es que una señal solo funciona si es suficientemente costosa para los actores de baja calidad. Si fuera gratis, todos la emitirían y no distinguiría nada.

Aplicado a la IA: al principio, implementar inteligencia artificial en un producto era una señal genuinamente costosa. Requería equipos de investigación, datos propios, infraestructura de entrenamiento. Solo las empresas que invertían de verdad podían hacerlo. La señal separaba. Pero a partir de 2023, el coste de "tener IA" se desplomó. Las APIs de modelos de lenguaje hicieron posible que cualquier producto añadiera un chatbot, un asistente, una función de resumen o generación de texto con semanas de trabajo de integración. La señal se abarató.

Cuando una señal es barata de producir, deja de separar. En la terminología de Spence, pasamos de un equilibrio separador — donde la señal distingue a los buenos de los malos — a un equilibrio de agrupamiento (pooling equilibrium), donde todos emiten la misma señal y el mercado no puede distinguir calidad. Es exactamente lo que observamos: todos son "AI-powered", y eso hace que la etiqueta no signifique nada.

El ciclo conocido

Esto ha ocurrido antes. A finales de los 90, empresas de todo tipo añadieron ".com" a su nombre. Pets.com, Webvan, Kozmo.com. Empresas de comida para mascotas, supermercados, mensajería — negocios que existían antes de internet y seguirían existiendo después — se redefinieron como empresas de internet. La señal "somos una empresa .com" atraía inversores, talento y atención. Hasta que dejó de separar, porque todos la emitían, y el mercado descubrió que muchas de esas empresas no eran más que negocios convencionales con un dominio nuevo.

Una década después, el ciclo se repitió con "cloud". Productos que corrían en servidores propios se declararon "cloud-based". Luego con "mobile-first": aplicaciones que no eran mobile-first pero lo declaraban. Cada ola tecnológica sigue el mismo patrón: una innovación genuina genera una señal valiosa → la señal atrae inversión y atención → el coste de emitir la señal baja → todos la emiten → la señal se convierte en ruido → el mercado necesita una nueva señal separadora.

El patrón es tan regular que debería preocuparnos. Porque lo que describe no es un fallo de información que se corrige con transparencia. Es una propiedad estructural de cómo los mercados procesan la novedad tecnológica.

El limón inteligente

Volvamos a Akerlof. Cuando la señal "AI" deja de distinguir calidad, el comprador se encuentra en la posición del comprador de coches de segunda mano: no puede separar buenos productos de malos. Ofrece un precio medio. Los buenos productos quedan infravalorados. Los malos, sobrevalorados. Los vendedores con IA genuinamente buena se frustran: han invertido en capacidad real pero el mercado no los recompensa porque la etiqueta ya no vale nada.

El hallazgo más interesante de Erlei es que hay una salida parcial: la revelación de limitaciones. Los vendedores que admiten abiertamente las debilidades de su sistema — dónde falla, qué no puede hacer, en qué contextos no funciona bien — generan mejores resultados de mercado que los que presentan demos impecables. Parece contraintuitivo, pero la lógica es puramente spenciana: admitir limitaciones es costoso para los malos (porque tienen muchas más que revelar) y relativamente barato para los buenos. Es una nueva señal separadora.

Pero aquí es donde Herbert Simon entra en la conversación. En Designing Organizations for an Information-Rich World (1971), Simon observó que una riqueza de información crea una pobreza de atención. En un mercado donde todos dicen "somos AI" y algunos añaden informes de transparencia y auditorías de rendimiento y documentación de limitaciones, el problema se desplaza: ya no es que no haya información. Es que no hay atención para procesarla. El comprador, que ya no podía evaluar la calidad antes, ahora tampoco puede evaluar la calidad de las evaluaciones.

In an information-rich world, the wealth of information means a dearth of something else: a scarcity of whatever it is that information consumes. What information consumes is rather obvious: it consumes the attention of its recipients.

— Herbert Simon, Designing Organizations for an Information-Rich World (1971)

El evaluador evaluado

Hay algo que distingue a esta ola de las anteriores.

El ".com" no podía evaluar si una empresa era realmente digital. El "cloud" no podía auditar si un servicio corría en la nube. Eran etiquetas inertes. Pero la IA es una tecnología que, al menos en teoría, podría usarse para evaluar las propias afirmaciones sobre IA. Un sistema que analice benchmarks, compare rendimiento real con el declarado, audite demos contra comportamiento en producción.

La paradoja es que el evaluador sería del mismo tipo que lo evaluado. Y en un mercado donde la información sobre calidad ya es asimétrica, introducir un intermediario opaco no resuelve el problema — lo desplaza un nivel más arriba. ¿Quién evalúa al evaluador? ¿Con qué señales de calidad?

Arrow, en The Economics of Information, formalizó la paradoja fundamental de los bienes de información: no puedes saber cuánto vale la información hasta que la tienes, pero una vez que la tienes ya no necesitas comprarla. Los sistemas de IA son bienes de información por excelencia — bienes de experiencia, en la terminología de Shapiro y Varian: no sabes si funcionan hasta que los usas en tu contexto, pero no puedes usarlos sin antes invertir en ellos.

Si la etiqueta "AI" deja de distinguir calidad — como ".com" dejó de distinguirla en 2001 —, ¿cuál será la siguiente señal separadora? ¿O estamos ante una asimetría más profunda, donde la complejidad del propio objeto evaluado hace que ninguna señal pueda mantenerse separadora el tiempo suficiente?

Los economistas de la información llevan sesenta años mapeando este territorio. Stigler describió el coste de buscar. Arrow describió la paradoja de valorar lo que no conoces. Akerlof describió cómo los mercados colapsan cuando no puedes distinguir. Spence describió cómo las señales costosas restauran la separación. Simon describió por qué, incluso con toda la información del mundo, la atención es finita.

Lo que no describieron — lo que quizá no se pueda describir desde dentro de la economía — es por qué cada nueva tecnología repite la misma secuencia, como si el mercado no tuviera memoria. O como si la memoria no bastara.